英伟达被“偷家”?全新AI芯片横空出世 速度比GPU快十倍

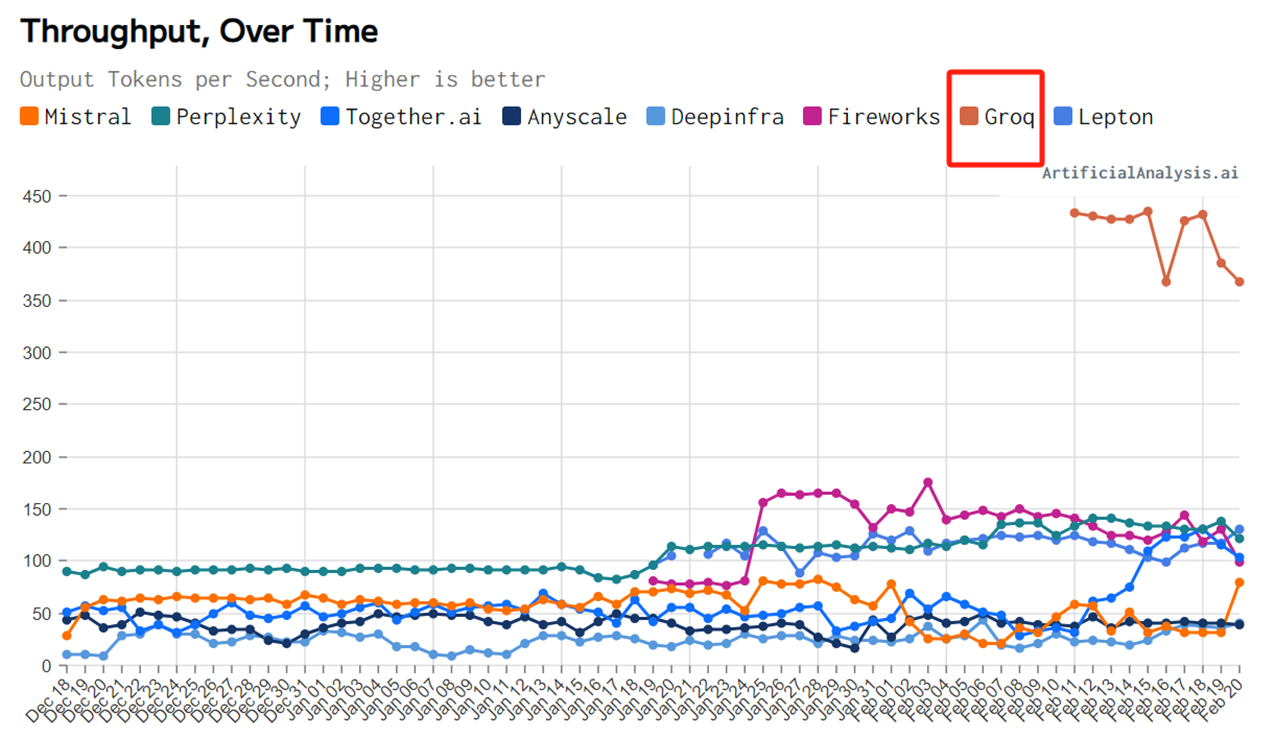

2月20日讯芯片推理速度较英伟达GPU提高10倍、成本只有其1/10;运行的大模型生成速度接近每秒500tokens,碾压ChatGPT-3.5大约40tokens/秒的速度——短短几天,一家名为Groq的初创公司在AI圈爆火。

Groq读音与马斯克的聊天机器人Grok极为接近,成立时间却远远早于后者。其成立于2016年,定位为一家人工智能解决方案公司。

在Groq的创始团队中,有8人来自仅有10人的谷歌早期TPU核心设计团队。例如,Groq创始人兼CEOJonathanRoss设计并实现了TPU原始芯片的核心元件,TPU的研发工作中有20%都由他完成,之后他又加入GoogleX快速评估团队,为谷歌母公司Alphabet设计并孵化了新Bets。

虽然团队脱胎于谷歌TPU,但Groq既没有选择TPU这条路,也没有看中GPU、CPU等路线。Groq选择了一个全新的系统路线——LPU(LanguageProcessingUnit,语言处理单元)。

“我们(做的)不是大模型,”Groq表示,“我们的LPU推理引擎是一种新型端到端处理单元系统,可为AI大模型等计算密集型应用提供最快的推理速度。”

从这里不难看出,“速度”是Groq的产品强调的特点,而“推理”是其主打的细分领域。

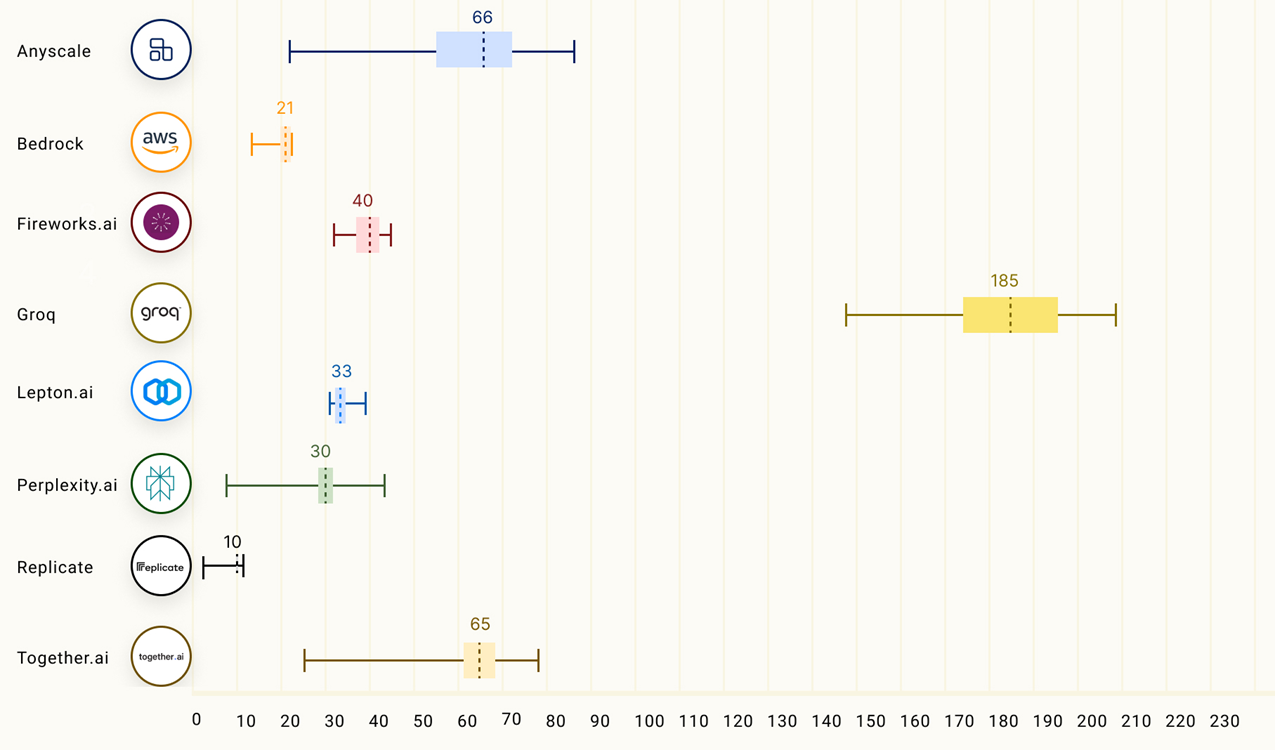

Groq也的确做到了“快”,根据Anyscale的LLMPerf排行显示,在GroqLPU推理引擎上运行的Llama270B,输出tokens吞吐量快了18倍,由于其他所有云推理供应商。

第三方机构artificialanalysis.ai给出的测评结果也显示,Groq的吞吐量速度称得上是“遥遥领先”。

为了证明自家芯片的能力,Groq还在官网发布了免费的大模型服务,包括三个开源大模型,Mixtral8×7B-32K、Llama2-70B-4K和Mistral7B-8K,目前前两个已开放使用。

图|Groq(Llama2)对比ChatGPT(来源:X用户JayScambler)

LPU旨在克服两个大模型瓶颈:计算密度和内存带宽。据Groq介绍,在LLM方面,LPU较GPU/CPU拥有更强大的算力,从而减少了每个单词的计算时间,可以更快地生成文本序列。此外,由于消除了外部内存瓶颈,LPU推理引擎在大模型上的性能比GPU高出几个数量级。

据悉,Groq芯片完全抛开了英伟达GPU颇为倚仗的HBM与CoWoS封装,其采用14nm制程,搭载230MBSRAM,内存带宽达到80TB/s。算力方面,其整型(8位)运算速度为750TOPs,浮点(16位)运算速度为188TFLOPs。

值得注意的是,“快”是Groq芯片主打的优点,也是其使用的SRAM最突出的强项之一。

SRAM是目前读写最快的存储设备之一,但其价格昂贵,因此仅在要求苛刻的地方使用,譬如CPU一级缓冲、二级缓冲。

华西证券指出,可用于存算一体的成熟存储器有NorFlash、SRAM、DRAM、RRAM、MRAM等。其中,SRAM在速度方面和能效比方面具有优势,特别是在存内逻辑技术发展起来之后,具有明显的高能效和高精度特点。SRAM、RRAM有望成为云端存算一体主流介质。

免责声明:本页所载内容来旨在分享更多信息,不代表九方智投观点,不构成投资建议。据此操作风险自担。投资有风险、入市需谨慎。

相关股票

相关板块

相关资讯

扫码下载

九方智投app

扫码关注

九方智投公众号

头条热搜

涨幅排行榜

暂无评论

赶快抢个沙发吧